这是我们准备参加竞赛用的知识帖子。希望大家通过学习过程中研究tensorflow源码。了解背景知识,再熟悉源码结构,编写简单例子。参加我们,就给我们留言吧

一、预处理

1、引入必要的包

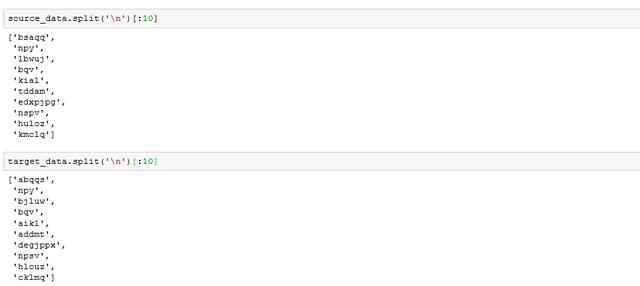

打开source和target两个txt文件,并打印前十个数据

2、数据预处理

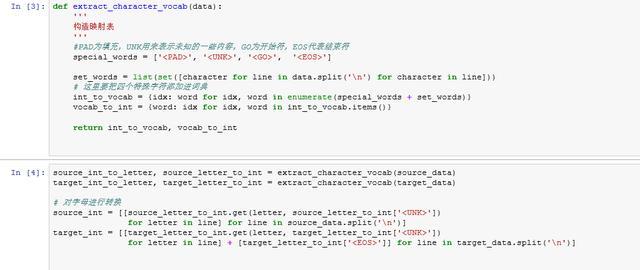

这个阶段主要对每个字母映射为唯一不同的数字

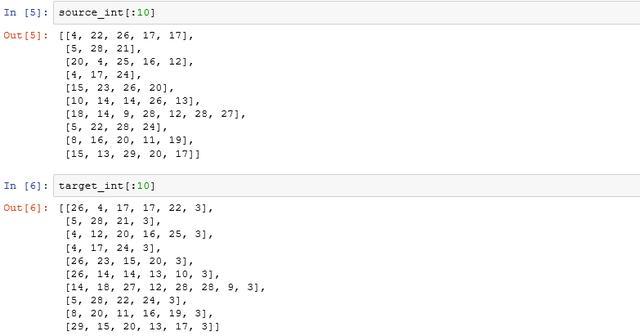

查看转换后的结果,可见每个字母都被映射为唯一的数字。

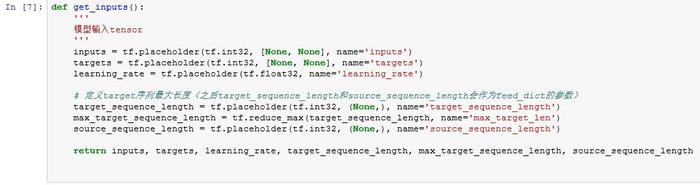

3、获取输入

4、定义Encoder层

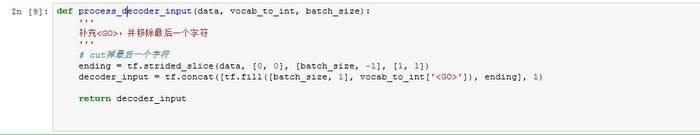

5、定义decoder层输入

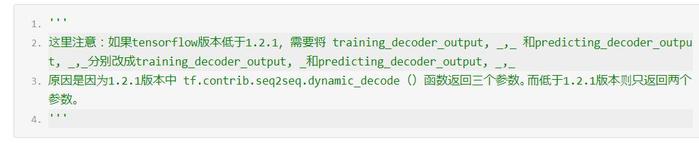

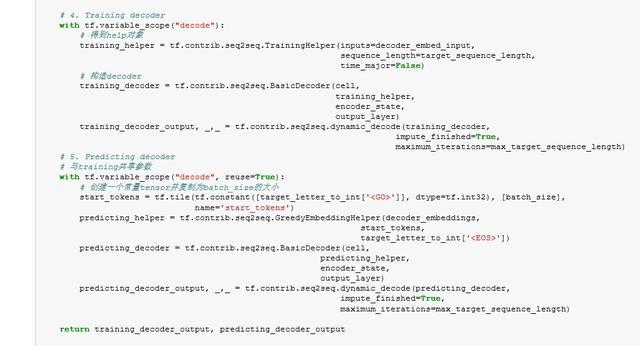

6、定义decoder层

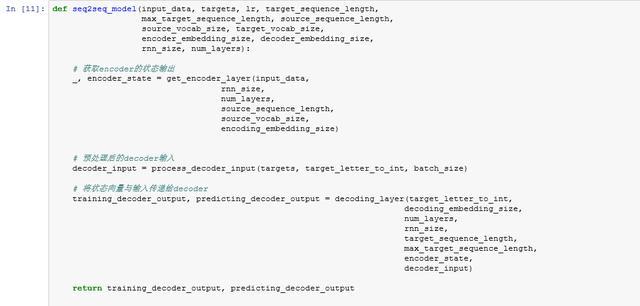

二、定义seq2seq模型

7、模型定义

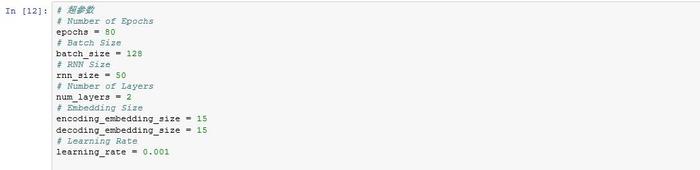

8、定义超参数

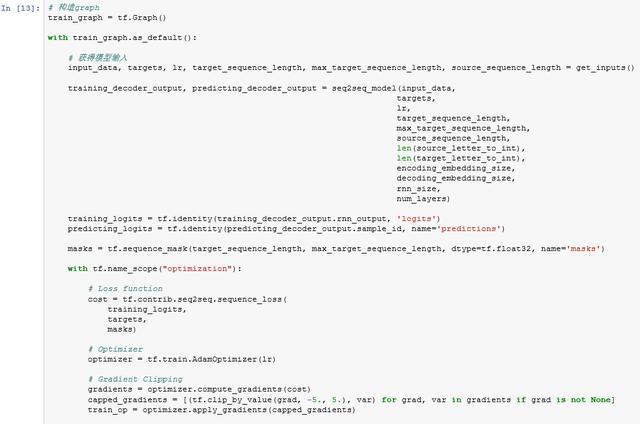

9、构造graph

10、对batch中的序列进行补全

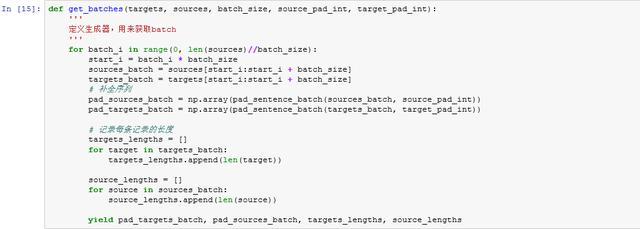

11、定义生成器,用来获取batch

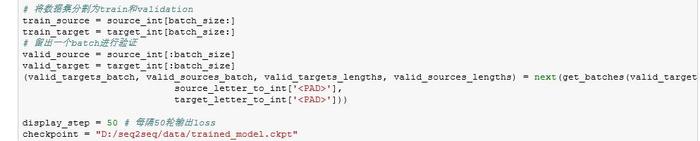

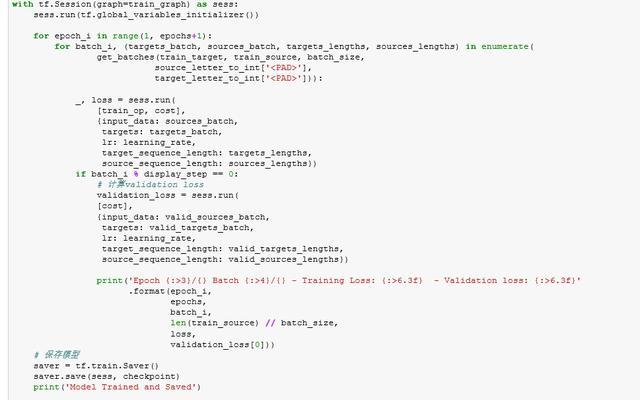

12、训练并保存模型

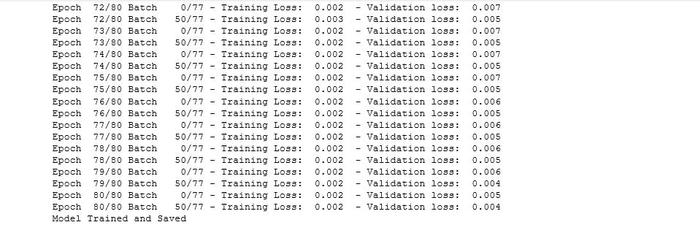

13、训练过程如下图所示:

三、测试

14、对源数据进行转换

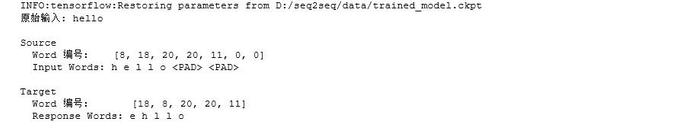

15、测试图片:

16、最终的输出结果为:

我们专注深度学习社群,想参加我们,就给我们留言吧!

0条评论|0人参与网友评论

表情

登录|注册

|退出

分享到微博

发布最热评论

最新评论

更多精彩评论>>

财经自媒体联盟

4000520066 欢迎批评指正

Copyright © 1996-2019 SINA Corporation

All Rights Reserved 新浪公司 版权所有

All Rights Reserved 新浪公司 版权所有

第一财经日报

第一财经日报  每日经济新闻

每日经济新闻  贝壳财经视频

贝壳财经视频  尺度商业

尺度商业  财联社APP

财联社APP  量子位

量子位  财经网

财经网  华商韬略

华商韬略