人工智能的现代概念已经伴随我们走过了几十年,但直到最近,人工智能才抓住了日常生活、商业和社会的集体心理。

人工智能是指计算机和系统执行通常需要人类认知才能完成任务的能力。人工智能与人的关系是共生的,其“触角”触及人类生产、生活的方方面面,从疾病患者的早期检测和更好的治疗,到各种形式和各种规模企业新的收入来源和更好的运营管理,如今已是无处不在。

自1950年图灵测试以来,人工智能工具和技术已经取得了令人难以置信的进步,其中许多突破性进展一直在业界的关注下被频繁发掘。尽管如此,直到过去十年,人工智能才真正应用于满足大众需求的场景,智能语言助理、自动驾驶汽车、生成式AI等等彻底改变了大众市场的需求格局。

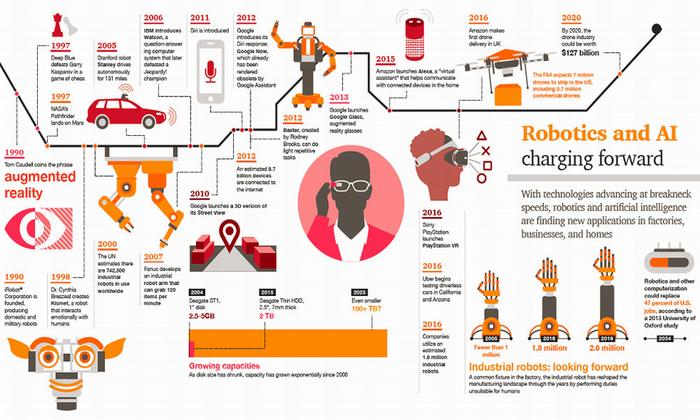

我们或许可以透过人工智能发展迄今为止的历史时间表来思考AI的未来,以及对大众生活的影响:

1950年艾伦•图灵发表了《计算机器与智能》,图灵测试打开了通向人工智能的大门。1951年Marvin Minsky 和 Dean Edmonds 使用3000个真空管来模拟由40个神经元组成的网络,开发了第一个名为SNARC的人工神经网络(ANN)。1952年Arthur Samuel开发了Samuel Checkers-Playing Program,这是世界上第一个自学游戏的程序。1956年约翰•麦卡锡、马文•明斯基、纳撒尼尔•罗切斯特和克劳德•香农在一项研讨会提案中创造了“人工智能”一词,该研讨会被广泛认为是人工智能领域的创始活动。1958年弗兰克•罗森布拉特开发了感知器,这是一种可以从数据中学习的早期人工神经网络,可以看成是现代神经网络的基础。约翰•麦卡锡开发了Lisp编程语言,该语言很快被人工智能行业采用,并受到开发人员欢迎。1959年亚瑟•塞缪尔在一篇开创性论文中创造了“机器学习”一词,解释说明计算机可以通过编程来超越程序员。Oliver Selfridge发表了《Pandemonium:学习范式》,这是对机器学习的里程碑式贡献,它描述了一种可以自适应改进自身以发现事件模式的模型。1964年Daniel Bobro在麻省理工学院攻读博士期间开发了STUDENT,这是一个早期的自然语言处理NLP程序,旨在解决代数相关问题。1965年Edward Feigenbaum、Bruce G. Buchanan、Joshua Lederberg和Carl Djerassi开发了第一个专家系统Dendral,该系统帮助有机化学家识别未知的有机分子。1966年Joseph Weizenbaum创建了Eliza,这是有史以来最著名的计算机程序之一,它能够与人类进行对话,并使人相信该软件具有人类情感。斯坦福研究院开发了首款结合人工智能、计算机视觉、导航和自然语言处理的移动智能机器人Shakey。它是自动驾驶汽车和无人机的鼻祖。1968年Terry Winograd创建了SHRDLU,这是第一个多模态人工智能,可以根据用户指令操作并推理出一个由块组成的世界。1969年Arthur Bryson和Yu-Chi Ho描述了一种可实现多层人工神经网络的反向传播学习算法,它是感知器的技术的延伸,也是深度学习的基础。Marvin Minsky和Seymour Papert出版了《感知器》一书,描述了简单神经网络的局限性,这导致了神经网络研究的衰落,符号人工智能研究得以蓬勃发展。1973年詹姆斯•莱特希尔发布的《人工智能:综合调查》报告导致英国大幅减少对人工智能研究的支持。1980年符号Lisp机器商业化,标志着人工智能研究复兴。但几年后,Lisp机器市场崩溃了。1981年Danny Hillis为人工智能和其他计算任务设计了并行计算机,其架构类似于现代GPU。1984年马文•明斯基和罗杰•尚克在人工智能促进协会的一次会议上创造了“人工智能冬天”一词,警告商界人工智能炒作将导致大众失望和行业崩溃,这在三年后发生了。1985年Judea Pearl引入了贝叶斯网络因果分析,它提供了表示计算机中不确定性的统计技术。1988年彼得•布朗等人发表了“语言翻译的统计方法”,为机器翻译方法的更广泛的研究铺平了道路。1989年Yann LeCun、Yoshua Bengio和Patrick Haffner演示了如何使用卷积神经网络(CNN) 来识别手写字符,表明神经网络可以应用于现实世界的问题。1997年Sepp Hochreiter和Jürgen Schmidhuber提出了长短期记忆递归神经网络,它可以处理整个数据序列,例如语音或视频。IBM的“深蓝”在一场历史性的国际象棋复赛中击败了加里•卡斯帕罗夫,这是国际象棋卫冕世界冠军在锦标赛上首次被计算机打败。2000年蒙特利尔大学的研究人员发表了“神经概率语言模型”,提出了一种使用前馈神经网络来建模语言的方法。2006年李飞飞开始研究(后来于2009年推出)ImageNet视觉数据库,该数据库成为了人工智能热潮的催化剂,也是图像识别算法年度竞赛的基础。2009年Rajat Raina、Anand Madhavan和Andrew Ng发表了《使用图形处理器进行大规模深度无监督学习》,提出了使用GPU训练大型神经网络的想法。2011年Jürgen Schmidhuber、Dan Claudiu Cireşan、Ueli Meier和Jonathan Masci开发了第一个CNN,并赢得了德国交通标志识别竞赛,从而实现了“超人”的性能。同年,苹果发布了Siri语音助理。2012年Geoffrey Hinton、Ilya Sutskever和Alex Krizhevsky介绍了一种深度CNN架构,该架构赢得了ImageNet 挑战并引发了深度学习研究和实现的爆炸式增长。2013年天河二号以33.86petaflops的速度将世界顶级超级计算速度提高了一倍,连续第三次蝉联世界最快系统的称号。DeepMind引入深度强化学习,这是一种基于奖励和重复学习的CNN,抵达了人类专家的水平。谷歌研究员Tomas Mikolov及其同事引入了Word2vec,以自动识别单词之间的语义关系。2014年Ian Goodfellow及其同事创造了生成对抗网络,这是一类用于生成照片、转换图像和深度模拟的机器学习框架。Diederik Kingma和Max Welling引入了变分自动编码器来生成图像、视频和文本。Facebook开发了深度学习面部识别系统DeepFace,能够以接近人类的准确度识别数字图像中的人脸。2016年DeepMind的AlphaGo在韩国首尔击败了围棋顶尖选手李世石。 优步在匹兹堡针对特定用户群体启动了自动驾驶汽车试点计划。2017年斯坦福大学研究人员在论文《使用非平衡热力学的深度无监督学习》中发表了有关扩散模型的研究成果。该技术提供了一种向图像添加噪声的过程进行逆向工程的方法。谷歌研究人员在论文Attention Is All You Need中提出了Transformer的概念,启发了后续对能够自动将未标记文本解析为大型语言模型 (LLM) 的工具的研究。英国物理学家史蒂芬•霍金警告说:“除非我们学会如何为潜在风险做好准备,否则人工智能可能成为人类文明史上最糟糕的事件。”2018年Cimon由IBM、空客公司和德国航空航天中心DLR开发,这是一个被送入太空协助宇航员的机器人。OpenAI发布了GPT(Generative Pre-trained Transformer),为后续的LLM铺平了道路。Groove X推出了一款名为Lovot的家用迷你机器人,它可以感知并响应人类的情绪变化。2019年微软推出了Turing Natural Language Generation生成语言模型,该模型拥有170亿个参数。谷歌人工智能和朗格医学中心的深度学习算法表明在检测潜在肺癌方面优于放射科医生。2020年Open AI发布了由1750亿个参数组成的GPT-3 LLM,用于生成式AI文本。英伟达宣布推出Omniverse平台测试版,用于在增强现实AR中创建3D模型。 2021年OpenAI推出了Dall-E多模态AI系统,可以根据文本提示生成图像。2022年谷歌软件工程师Blake Lemoine泄密Lamda架构并声称其具有感知能力。 DeepMind推出用于为矩阵乘法等数学问题发现新型、高效且可验证的算法的AI系统AlphaTensor。 英特尔声称其FakeCatcher实时Deepfake检测器的准确度为 96%。 OpenAI于11月发布了ChatGPT,基于GPT-3.5 LLM并提供终端用户使用的UI聊天界面。2023年OpenAI宣布推出GPT-4多模态LLM,可接收文本和图像输入。埃隆•马斯克、史蒂夫•沃兹尼亚克与数千位签名者敦促业界暂停训练“比GPT-4更强大的人工智能系统”六个月。2023年之后AI的历史仍在继续……

4000520066 欢迎批评指正

All Rights Reserved 新浪公司 版权所有